“Qwen 2.5-Max” من “علي بابا”.. نموذج صيني ينافس DeepSeek

يتفوق على GPT-4o وDeepSeek-V3، وLlama-3.1-405B

-

المنافسة تحتدم في قطاع الذكاء الاصطناعي الصيني

أطلقت شركة”علي بابا” الصينية إصدارا جديدا من نموذج الذكاء الاصطناعي “Qwen 2.5-Max” في خطوة تهدف إلى مواجهة الصعود السريع لمنافسه المحلي DeepSeek.

توقيت غير مألوف

اختارت شركة علي بابا توقيتًا لافتًا للإعلان عن نموذجها الجديد Qwen 2.5-Ma، حيث تم الكشف عنه في أول أيام السنة القمرية الجديدة، وهو يوم عطلة رسمية في الصين حيث يكون معظم الناس بعيدين عن العمل. هذا التوقيت يعكس الضغط الذي فرضه النمو السريع لشركة DeepSeek على كبرى الشركات الصينية، وليس فقط على المنافسين العالميين.

كيفية استخدام Qwen2.5-Max: دليل شامل لتشغيله بكل الطرق الممكنة

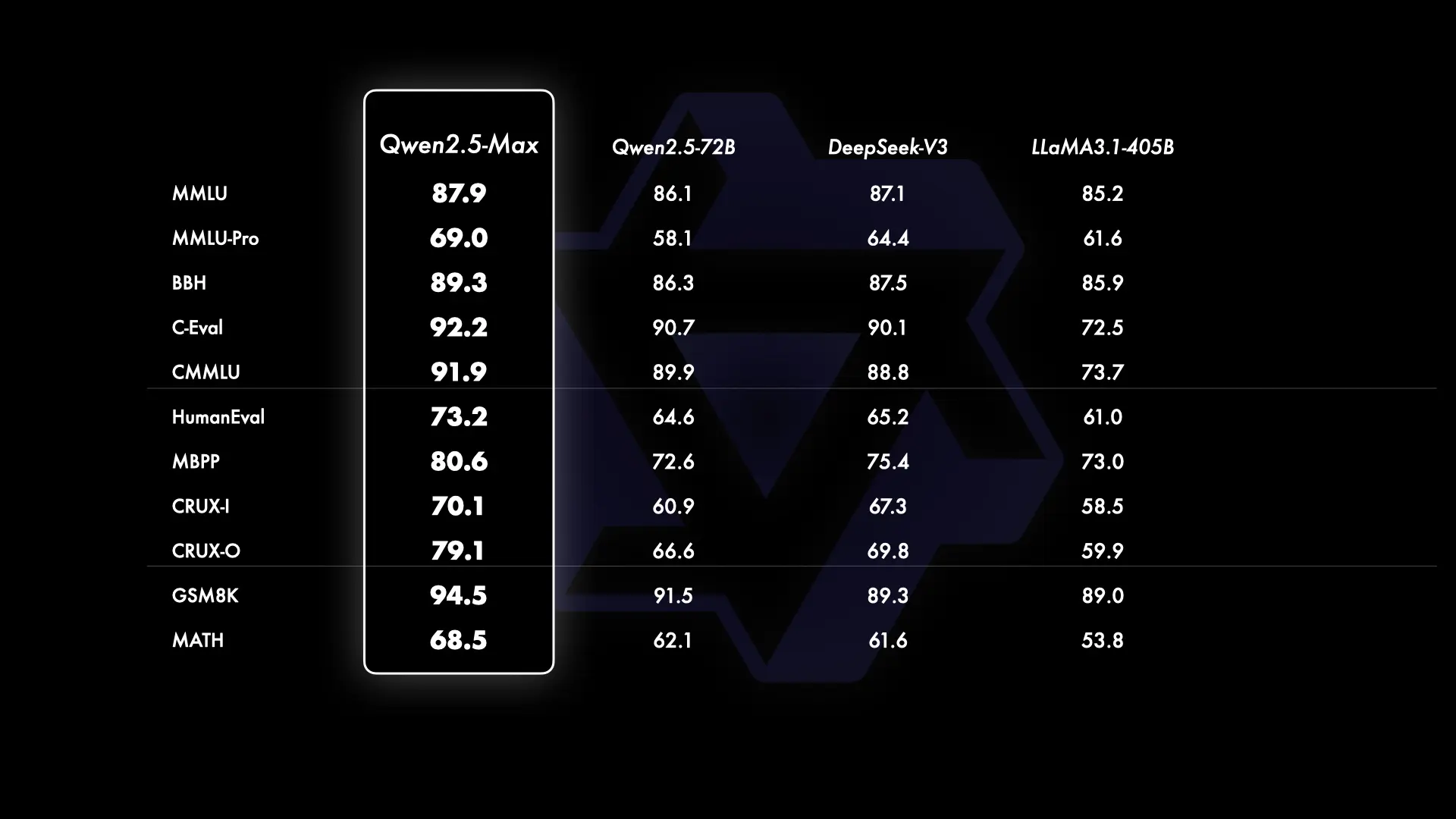

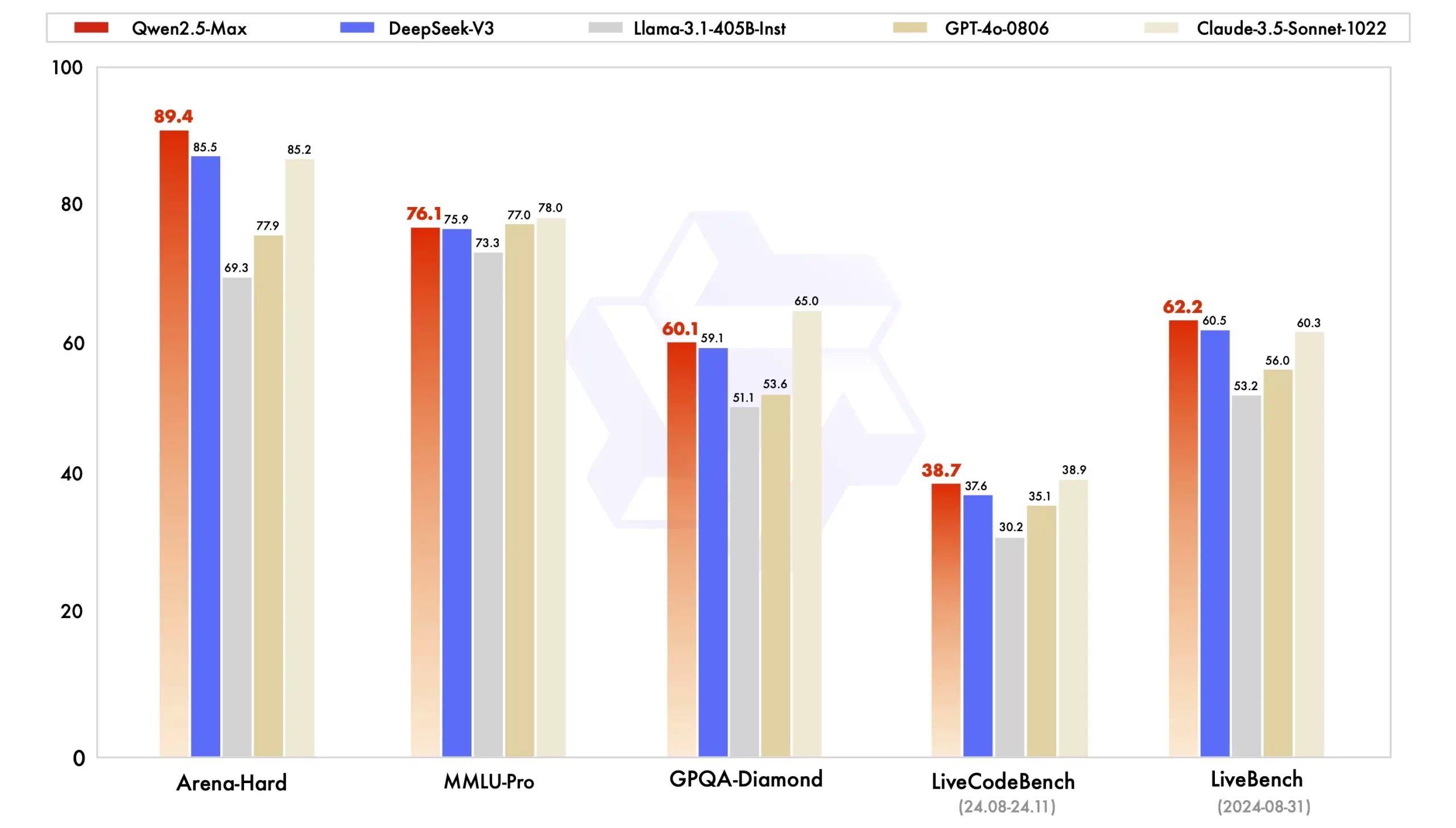

ووفقًا لإعلان وحدة الحوسبة السحابية التابعة لعلي بابا، فإن “Qwen 2.5-Max” يتفوق على نطاق واسع على GPT-4o من OpenAI، وDeepSeek-V3، وLlama-3.1-405B من Meta، في إشارة واضحة إلى دخول علي بابا بقوة في سباق التفوق في نماذج الذكاء الاصطناعي.

-

صعود DeepSeek وإرباك المنافسين

يأتي إطلاق النموذج الجديد من علي بابا بعد النجاح المدوي الذي حققته DeepSeek خلال الأسابيع الماضية. فقد أطلقت الشركة في 10 يناير مساعدها الذكي القائم على نموذج DeepSeek-V3، ثم تبعته في 20 يناير بإصدار نموذج DeepSeek-R1، مما أثار ردود فعل قوية داخل وادي السيليكون وأدى إلى هبوط أسهم بعض شركات التكنولوجيا الكبرى.

أحد أبرز أسباب الجدل حول DeepSeek هو انخفاض تكاليف تطوير وتشغيل نماذجها مقارنة بالشركات الكبرى، مما دفع المستثمرين إلى التشكيك في جدوى الاستثمارات الضخمة التي تنفقها الشركات الأمريكية على تطوير الذكاء الاصطناعي. وفي ظل هذا المشهد، اضطرت الشركات الصينية الكبرى إلى الرد بسرعة لتعزيز نماذجها وتحديث قدراتها التنافسية.

-

ردود فعل الشركات الصينية الكبرى

لم تكن علي بابا وحدها في سباق التحديثات. فبعد يومين فقط من إطلاق DeepSeek-R1، أعلنت شركة ByteDance، المالكة لـTikTok، عن تحديث جديد لنموذجها الرئيسي، مؤكدة أنه يتفوق على نموذج o1 المدعوم من مايكروسوفت وفقًا لاختبار AIME، الذي يقيس قدرة الذكاء الاصطناعي على فهم الأوامر المعقدة والاستجابة لها بدقة.

من جهة أخرى، فإن إطلاق DeepSeek-V2 في مايو الماضي أثار موجة من حروب الأسعار داخل السوق الصينية، حيث اضطر علي بابا إلى تخفيض أسعار خدماته بنسبة تصل إلى 97% استجابةً لسعر DeepSeek-V2 التنافسي، الذي لم يكن يتجاوز 1 يوان لكل مليون توكن (حوالي 0.14 دولار). كما انضمت Baidu وTencent إلى موجة التخفيضات وإطلاق نماذج جديدة لمجاراة هذا التحول السريع.

-

التحليل التقني لنموذج Qwen2.5

-

التحسينات الرئيسية

-

الحجم والتكوينات المختلفة :

- يتضمن Qwen2.5 نماذج ذات أحجام مختلفة تتراوح بين 0.5B إلى 72B من المعلمات.

- تم إدخال نسخ جديدة بحجم 3B و14B و32B والتي تعتبر أكثر كفاءة من حيث التكلفة للسيناريوهات ذات الموارد المحدودة.

- توفر النماذج مثل Qwen2.5-Turbo وQwen2.5-Plus توازنًا جيدًا بين الدقة والتكلفة والزمن.

-

تحسين البيانات :

- تم زيادة بيانات ما قبل التدريب من 7 تريليون رمز إلى 18 تريليون رمز مع التركيز على المعرفة والبرمجة والرياضيات.

- تشمل بيانات ما بعد التدريب أكثر من مليون عينة، مما يعزز تفضيلات الإنسان ويحسن بشكل كبير إنشاء النصوص الطويلة وتحليل البيانات البنيوية ومتابعة التعليمات.

-

الاستخدام الفعلي :

- تمت معالجة العديد من القيود التي كانت موجودة في Qwen2، بما في ذلك زيادة طول النص المُنشأ (من 2K إلى 8K رمز)، ودعم أفضل للبيانات البنيوية (مثل الجداول وJSON)، واستخدام الأدوات بسهولة أكبر.

- يدعم Qwen2.5-Turbo سياقًا بطول يصل إلى مليون رمز.

البنية والمعمارية

- تعتمد سلسلة Qwen2.5 على بنية Transformer القائمة على التشفير (Vaswani et al., 2017; Radford et al., 2018).

- تشمل المكونات الرئيسية: Grouped Query Attention (GQA) للاستفادة الفعالة من ذاكرة KV، وSwiGLU لتفعيل غير الخطي، وRotary Positional Embeddings (RoPE) لتشفير المعلومات الموضعية.

ما قبل التدريب

- استفادت Qwen2.5 من تقنيات تصفية البيانات المتقدمة باستخدام نماذج Qwen2-Instruct لتحديد جودة بيانات التدريب.

- تم دمج بيانات متخصصة من Qwen2.5-Math وQwen2.5-Coder لتعزيز أداء النموذج في الرياضيات والبرمجة.

- تم استخدام نماذج Qwen2-72B-Instruct وQwen2-Math-72B-Instruct لإنشاء بيانات تركيبية عالية الجودة.

ما بعد التدريب

- تمت توسعة تغطية بيانات التدريب الخاضعة للإشراف لمعالجة المجالات التي أظهر فيها النموذج السابق قيودًا، مثل إنشاء النصوص الطويلة وحل المشكلات الرياضية والبرمجة.

- تمت عملية التعلم المعزز في مرحلتين: تعليم آلي دون اتصال (Offline RL) وتعليم آلي عبر الإنترنت (Online RL).

التقييم

- تم تقييم نماذج Qwen2.5 باستخدام مجموعة شاملة من مقاييس التقييم، بما في ذلك المعايير المفتوحة ومعايير التقييم الداخلية.

- أظهر Qwen2.5-72B-Instruct أداءً تنافسيًا للغاية مقارنة بالنماذج المفتوحة الأخرى مثل Llama-3-405B-Instruct.

- حققت النماذج الخاصة مثل Qwen2.5-Turbo وQwen2.5-Plus أداءً ممتازًا مقارنة بـ GPT-4o-mini وGPT-4o.

-

الاستنتاجات

- يعتبر Qwen2.5 خطوة مهمة نحو تحسين قدرات نماذج اللغة الكبيرة.

- يقدم النموذج تحسينات كبيرة في الحجم والبيانات والاستخدام الفعلي، مما يجعله خيارًا قويًا لمجموعة واسعة من التطبيقات.

- أظهر Qwen2.5 أداءً تنافسيًا في العديد من المهام مثل الفهم اللغوي، التفكير المنطقي، الرياضيات، البرمجة، والتفضيلات البشرية.

ماذا في الأفق؟

- رغم التحسينات الكبيرة، لا يزال هناك مجال للتطوير، خاصة في مجالات مثل التفاهم الثقافي والقدرة على التعامل مع السياقات الطويلة.

- يسعى الفريق إلى تحسين أساليب التقييم الخاصة بالنماذج المرجعية لضمان تنبؤ أفضل بأداء النماذج الناتجة عن التعليم المعزز.

مستقبل الذكاء الاصطناعي في الصين

يعكس الصراع الدائر بين DeepSeek والعمالقة التقليديين في الصين مرحلة جديدة في تطوير الذكاء الاصطناعي في البلاد. حيث لم تعد المنافسة مقتصرة على الأسماء الكبيرة فقط، بل دخلت الشركات الناشئة بقوة، مما أدى إلى سرعة في الابتكار، وانخفاض تكاليف النماذج، وزيادة في جودة الأداء.

ومع إطلاق Qwen 2.5-Max واحتمالية تصاعد المنافسة، فقد نشهد إعادة تشكيل لهيكل الصناعة، حيث تصبح الشركات الصغيرة سريعة الحركة أكثر تأثيرًا من الشركات الضخمة ذات الهيكلة التقليدية. وبالنظر إلى أن الذكاء الاصطناعي أصبح مجالًا استراتيجيًا للصين، فإن هذه المنافسة قد تؤدي إلى تطورات غير مسبوقة في هذا القطاع على المستوى العالمي.